Ray tracing / Strålspårning med Geforce RTX

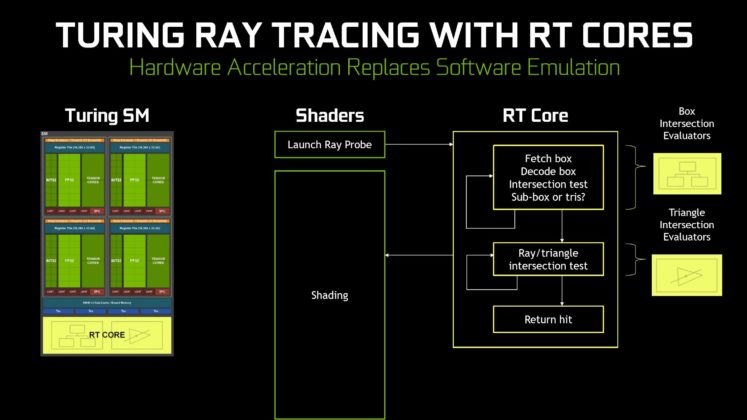

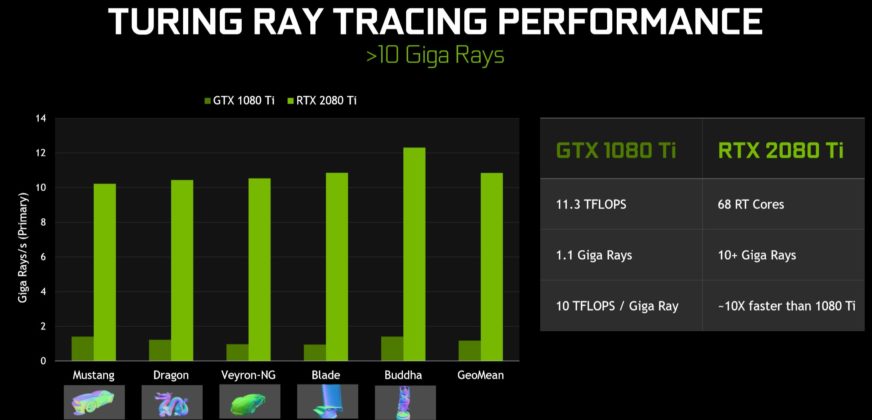

Rör vi oss vidare från traditionell rastrering i spel finnas vi stöd för vad som kallas för hårdvaruaccelererad Ray tracing (Svenska: Strålspårning) i realtid hos Turing. Detta stöd kommer från Nvidias nya RT-kärnor som utvecklats just för detta ändamål och integrerats i de Turing-baserade grafikprocessorerna.

Ray tracing har visats upp på många olika vis från Nvidia, AMD och Intel genom åren. Dock blir Nvidia först ut med att kunna erbjuda tekniken renderad i realtid i kompatibla spel. Tekniken erbjuder verklighetstrogna reflektioner och skuggor genom att på ett realistiskt vis få ljus att integrera med olika typer av ytor.

Under Nvidias Gamescom-event till exempel visade representanter från spelstudion Dice upp ray tracing i deras kommande spel Battlefield V. Många jämförelser med ray tracing av och på visades och det fanns en solklar skillnad i mängden reflektioner som syntes i till exempel bilar, vattenpölar, fönster och även spelkaraktärers ögon.

De nya RT-kärnorna är specialanpassade för att utföra just rendering av ray tracing i realtid. Detta är en uppgift som traditionella CUDA-kärnor inte är lämpade för och grafikkort baserade på äldre arkitekturer som till exempel Pascal har helt enkelt inte förutsättningarna för hårdvaruaccelererad ray tracing. Därför har RT-kärnorna utvecklats och implementerats som en individuell del av Turing-arkitekturen för att låta CUDA-kärnorna fokusera på rastrering och lämna ray tracing-belastningen till någon som kan.

En helt ny Streaming Multiprocessor & förbättrat cache-minne

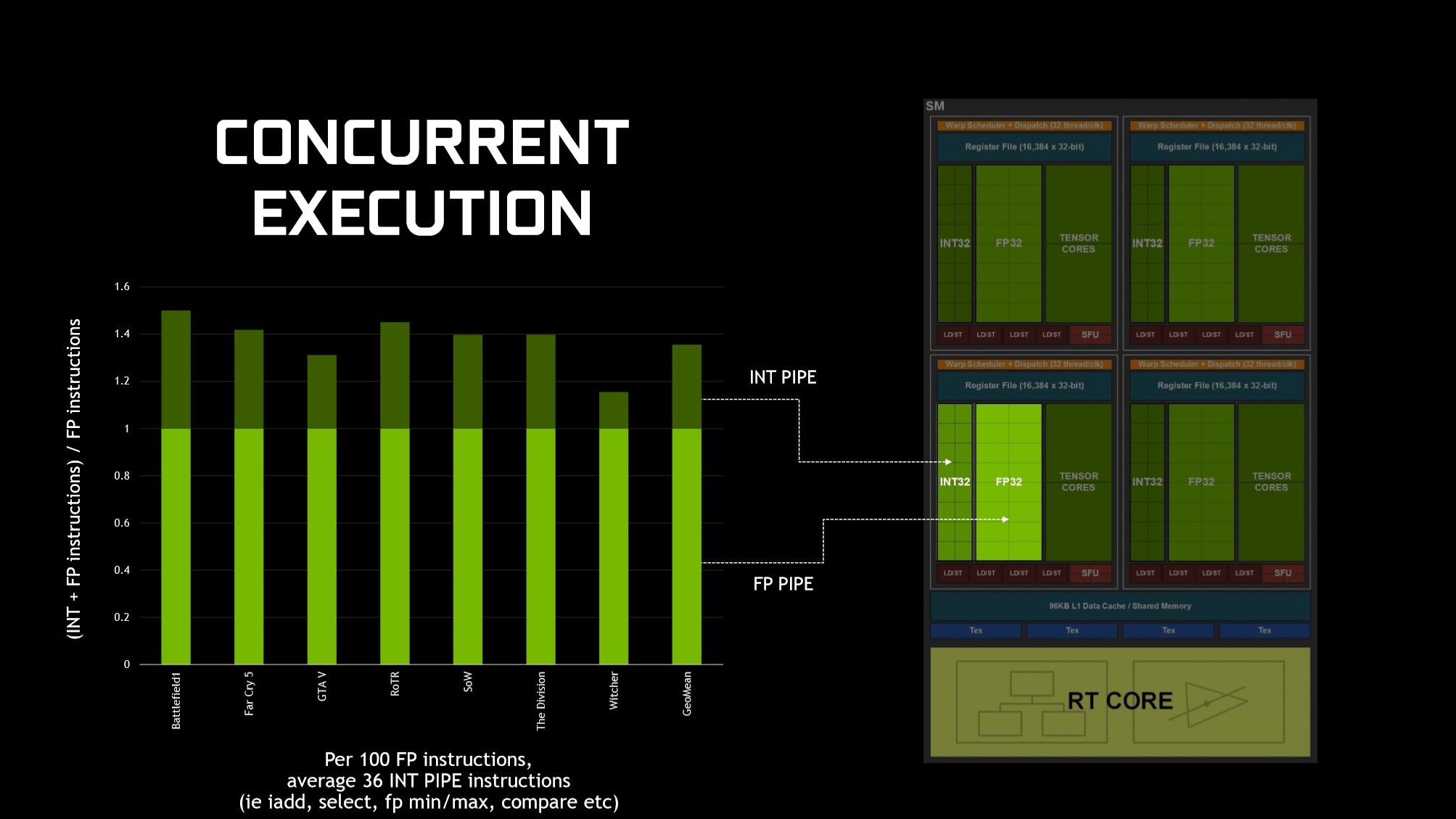

Hittills har vi kastat ett snabbt öga på några av de nya funktioner som kommer med Turing-arkitekturens RTX-grafikkort. Utöver dessa har Nvidia även ändrat uppbyggnaden av grafikprocessorerna Streaming Multiprocessor-enheter (SM). Den nya designen låter processorerna hantera flyttalsberäkningar (FP32) och heltalsberäkningar (INT32) samtidigt.

Medans spel för det mesta använder sig av FP32-beräkningar så är det även en del INT32-beräkningar som måste hanteras. Nvidia räknade ut att för varje 100 FP32-beräkningar så måste grafikprocessorer även hantera omkring 36 stycken INT32-beräkningar. Då arkitekturen Pascal inte kunde hantera dessa två olika belastningar samtidigt innebar det att när en INT32-beräkning hanterades satt de kärnorna som används för FP32-beräkningar och väntade. Något som resulterar i markant lägre prestanda än om de två kunde hanteras parallellt.

Tack vare att Turing kan hantera dessa två typer av beräkningar på en och samma gång påstår Nvidia att Turings SM-kluster och CUDA-kärnor kommer med en markant prestandaförbättring jämfört med de kluster som utgjorde Pascal-arkitekturen. Detta kommer dock att variera mellan speltitlar då ”spelbelastning” inte är en universell standard. Skillnaderna som denna teknik bidrar med kommer därför att bero på vilket spel som belastar grafikkorten.

Inuti varje SM-kluster hos Turing hittas även de tidigare nämnda AI-fokuserade Tensor-kärnorna som ger grafikkorten stöd för DLSS. Dessa kommer att arbeta individuellt från de traditionella CUDA-kärnorna och på så vis inte ta resurser från de komponenter som arbetar med rastrerad spelbelastning.

Turing har även fått uppdaterat och utökat cacheminne. Arkitekturens L1-cache kommer i en mängd om 96 kilobyte (KB) per SM och är Nvidia kallar för ”Flexibelt cacheminne”. Detta innebär att minnet kan delas upp för att till exempel ha en portion som agerar cacheminne för grafikshaders och en portion används till texturer.

Jämfört med Pascal kommer samtliga Turing-baserade grafikprocessorer med dubbelt så mycket L2-cache. Kikar vi på till exempel GP102 som var den drivande kraften bakom den förra generationens flaggskepp, GTX 1080 Ti, ser vi att denna har 3 megabyte (MB) L2-cache. Medans TP102 som utgör RTX 2080 Ti kommer med sammanlagt 6 MB L2-cache.

He he Reviwes har börjat dyka upp och än så länge är RTX ingenting som jag tänker köpa i alla fall. Får kolla in fler 4K bench innan jag gör slutgiltiga beslutet men det jag sätt hittills ser inte ut att vara värt det.

Vi har precis börjat bencha Morkul och det är utan tvekan kraftfulla kort (Vi har ännu bara 2080 inne) men ja det kostar onekligen…

Det blir att återkomma till detta snart och då med ett fokus på inte bara siffror utan faktiska upplevelser när man använder korten. 🙂

Vad jag har sett på de benchs som släppts idag så är ju 2080 ungefär som 1080ti och 2080 ti betydligt bättre men inte bra nog för att motivera det höga priset. Värt att tänkta på att jag endast tittat på 4K prestandan resten intresserar inte mig. Många skriver också om hur stressad denna release måste varit ifrån nVidias sida. Som det är nu finns det inga spel som stöder Ray Tracing i dagsläget och kommer dröja bra länge innan det finns så att det går att göra ordentlig analys. Sedan ska tilläggas att åtminstone en av de största testarna… Läs hela »